Dekódování řeči z lidského mozku. Naděje pro pacienty s poruchou řeči.

Vědci z University v Berkeley byli schopni identifikovat a syntetizovat slova, která pacienti slyšeli, dekódováním elektrických signálů ve spánkovém laloku, kde v mozku sídlí sluchový systém. Tento výzkum jim na jedné straně pomáhá pochopit, jak mozek dekóduje, co slyšíme, na straně druhé připravuje půdu technologiím umožňujícím syntetizovat řeč u pacientů, kteří nemohou mluvit v důsledku cévní mozkové příhody nebo ochrnutí.

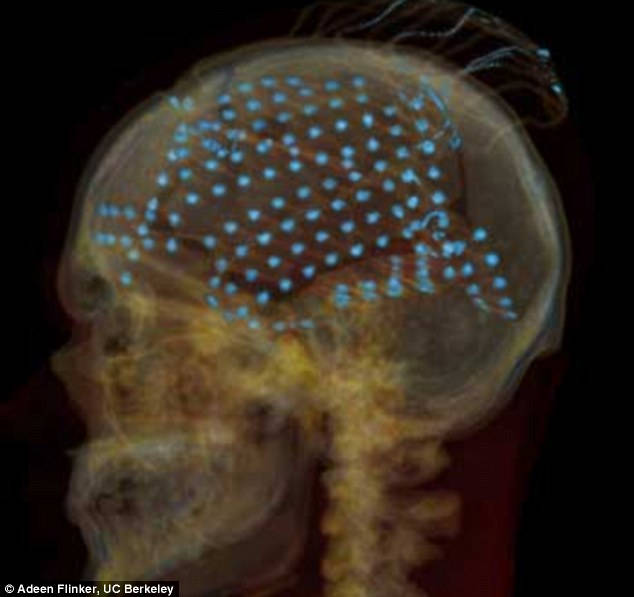

V oblasti vrchního temporálního gyrusu bylo umístěno až 2x128 elektrod.

Credit: Adeen Flinker, UC Berkeley

Tým pod vedením Briana Pasleyho se inspiroval metodou, díky které se loni jejich kolegům podařilo zaznamenat, co se promítá v lidské mysli a syntetizovat to ve formě videa. O studii, která byla zveřejněna 22. září 2011 v časopise Current Biology, jsme informovali na našem serveru v článku Vědci dokázali zaznamenat, co se promítá v lidské mysli.

Brian Pasley říká, že jeho tým jde v tzv. "stimulační rekonstrukci" ještě o krok dál, nicméně upozorňuje: "Náš výzkum je založen na zvucích, které daná osoba opravdu slyší, pro využití k rekonstrukci interní konverzace by ale jeho principy musely vycházet z individuální interní verbalizace daného jedince. Máme nicméně doklady o tom, že poslech konkrétního zvuku aktivuje podobné oblasti v mozku jako pouhá představa tohoto zvuku. Porozumíme-li dostatečně vztahům mezi zvukem a mozkovými záznamy, mohli bychom buď syntetizovat faktické zvuky, které se dané osobě honí hlavou, nebo je vygenerovat ve formě slov pomocí zařízení s odpovídajícím rozhraním."

"Tisíce lidí po mrtvici nebo s Amyotrofickou laterální sklerózou, jako např. fyzik Stephen Hawking, nemohou mluvit jen proto, že nedokáží ovládat potřebné svaly hrtanu a jazyka, dokáží si nicméně velmi dobře představit, co chtějí říci. Pro ně by takový implantát, který by umožňoval v reálném čase syntetizovat jejich myšlenky do zvuku, znamenal doslova vysvobození," tvrdí spoluautor studie Robert Knight, profesor neurověd a psychologie na Univerzitě Berkeley.

Výzkumníci z Univerzity v Berkeley publikovali svoji práci v časopise PLoS Biology dne 31. ledna 2012. Práce je přístupná on-line v plném znění zde nebo jako pdf.

reklama

Pomohli pacienti s epilepsií

Výzkum byl umožněn díky 15 dobrovolníkům, epileptickým pacientům, kteří byli ochotni podstoupit operaci, při níž měly být lokalizovány a odstraněny pravděpodobné zdroje jejich nezvladatelných záchvatů. Při této operaci je totiž potřeba otevřít lebku a přímo na povrch mozku umístit pole elektrod. Těmto dobrovolníkům byla odposlouchávána zvláště oblast vrchního temporálního gyrusu neboli STG z anglického superior temporal gyrus, kde bylo rozmístěno až 256 elektrod. Signály byly takto snímány po dobu jednoho týdne.

Pasley tímto způsobem u každého dobrovolníka zaznamenal aktivitu jeho mozku při 5-10 minutové konverzaci. Z naměřených dat se mu poté podařilo zrekonstruovat a přehrát zvuky, které pacienti slyšeli. Mozek totiž rozkládá zvuk na jednotlivé složky charakterizované frekvencí. Pro řeč je nejpodstatnější rozsah 1Hz až 8000Hz.

Při hledání souvislostí mezi poslouchanými zvuky a vzorci mozkových aktivit na elektrodách Pasley testoval dva výpočetní modely. Poté se s jejich pomocí pokoušel předvídat, jaké slovo pacient právě slyší a to čistě jen ze záznamů mozkové činnosti pořízených elektrodami.

Tento výzkum je významným krokem k pochopení toho, jak je v mozku reprezentována řeč.

"Sledujeme, ve kterých místech mozkové kůry dochází ke zvyšování aktivity v závislosti na jednotlivých akustických frekvencích, a podle toho zvuk zpětně mapujeme. Přirovnal bych to k hluchému pianistovi, který zná, jak která klávesa zní natolik dobře, že mu stačí jen vidět, jak někdo jiný hraje a v podstatě "slyší" hudbu, jako například Ludwig van Beethoven," říká Pasley.

Lepšímu z uvedených dvou modelů se dařilo reprodukovat zvuk, který byl původním slovům natolik podobný, že se Pasleymu a jeho kolegům dařilo tato slova celkem bezchybně odhadovat.

"Přesnějších výsledků bychom zřejmě dosáhli při prodloužení doby poslechu a nahrávání na 1 hodinu a při několikanásobném opakování slov," řekl Pasley. Reálný přístroj by však měl jednotlivá slova identifikovat přesně, už když je slyší poprvé, proto jsme se rozhodli vyzkoušet modely pracující pouze s jednou ukázkou.

reklama

"Tento výzkum je významným krokem k pochopení toho, jak je v mozku reprezentována řeč," říká Knight. "Ačkoli naše metoda není zdaleka dokonalá, dokážeme zpětně reprodukovat zvuk, který pacient vyslechl tak, že je skutečně možné rozpoznat, které konkrétní slovo to bylo."

Knight předvídá, že úspěch jejich pokusu by mohl být dále rozšířen na imaginární vnitřní komunikaci, bylo totiž prokázáno, že když jsou lidé požádáni, aby si jen představili, že vyslovují určité slovo, aktivují se jim v mozku podobné oblasti, jako když dané slovo opravdu vysloví.

Pohybovat kurzorem myši či ovládat pohyb robotické či virtuální paže pouhou myšlenkou díky voperovaným neuroimplantátům se již v minulosti podařilo. Úspěšný experiment výzkumníků z Univerzity v Berkeley otevírá dveře porozumění procesům zpracování řeči v mozku a to je zase o úroveň výš.

Dekódování řeči z lidského mozku

Výzkumníci těží z předchozích pokusů na fretkách

Současný výzkum navazuje na předchozí práce jiných vědců, kteří zjišťovali, jak je zvuk kódován ve sluchových oblastech mozkové kůry zvířat. Výzkumníci z Univerzity v Marylandu byli například schopni z aktivit sluchového centra fretky odposlechnout, jaké slovo zvíře slyšelo, přestože mu samozřejmě nemohlo rozumět.

Hlavním cílem studie výzkumníků z UC Berkeley bylo prozkoumat, jak lidský mozek kóduje řeč a stanovit, které její aspekty jsou nejdůležitější pro její porozumění.

"To, že dokážeme slovům a řeči rozumět bez ohledu na to, jak zní, znamená, že mozek musí všechny podstatné informace ze zvuku nějak extrahovat a namapovat je na slova. Principiální otázkou je, která jednotka řeči je z hlediska informační hodnoty nejvýznamnější? Slabika, fón nebo foném? S pomocí naší metody teď můžeme tyto jednotlivé hypotézy vyzkoušet," říká na závěr Brian N. Pasley.

Určité etické obavy, že by tato technologie mohla vést ke skrytému čtení mysli vědci odmítají s tím, že se jejich technologie neobejde bez chirurgického otevření lebky, k čemuž je vždy potřeba spolupráce s danou osobou.

Spoluautory studie jsou elektroinženýři Stephen V. David, Nima Mesgarani a Shihab A. Shamma z University of Maryland; Adeen Flinker z Helen Wills Neuroscience Institututu při Univerzitě Berkeley; neurolog Nathan E. Crone z The Johns Hopkins University v Baltimoru. Práce byla dělána převážně v laboratoři Roberta Knighta na UC Berkeley a Edwarda Changa, neurochirurga na UCSF.

Práce byla podpořena Národním institutem neurologických poruch a mozkových mrtvicí, Národním Institutem zdraví a Nadací Humboldt.

Příklad nelineárního modulačního kódování a rekonstrukce

Zdroje a odkazy

Scientists decode brain waves to eavesdrop on what we hear berkeley.edu

Reconstructing Speech from Human Auditory Cortex plos.org

Voicegrams transform brain activity into words nature.com

Science decodes 'internal voices' bbc.co.uk

Mind-reading program translates brain activity into words theguardian.com

Scientists Learn How to Eavesdrop on the Brain time.com

Decoding brain waves to eavesdrop on what we hear medicalxpress.com

Scientists decode brain waves to eavesdrop on what we hear kurzweilai.net

Scientists decode brain waves to eavesdrop on what we hear sciencedaily.com

Budeme si číst myšlenky? osel.cz (Jaroslav Petr)